이 글은 tensorflow-gpu, PyTorch를 사용하기 위해 CUDA와 cuDNN을 설치한다는 가정을 가지고 그 과정을 설명한다.

1. GPU와 호환되는 CUDA (CUDA Toolkit) 버전 확인

1) 본인 GPU 사양 확인

CUDA 버전을 확인하기 전에 본인의 GPU 사양을 아는 것이 우선이다.

GPU 확인은 Ctrl+Alt+Del를 통해 작업 관리자를 열어 확인할 수 있다. 작업 관리자를 들어왔으면 성능 탭으로 가서 GPU를 선택하고 GPU 사양을 확인하면 된다. 필자의 경우 GPU사양은 GeForce RTX 3060 Ti이다.

2) 호환되는 CUDA 버전 확인

이제 내 GPU 사양을 확인했으니, 내 GPU와 호환되는 CUDA의 버전을 확인한다. 호환되는 CUDA 버전은 아래 사이트에서 확인할 수 있다.

https://en.wikipedia.org/wiki/CUDA#GPUs_supported

CUDA - Wikipedia

From Wikipedia, the free encyclopedia Parallel computing platform and programming model In computing, CUDA (Compute Unified Device Architecture) is a proprietary[2] parallel computing platform and application programming interface (API) that allows softwar

en.wikipedia.org

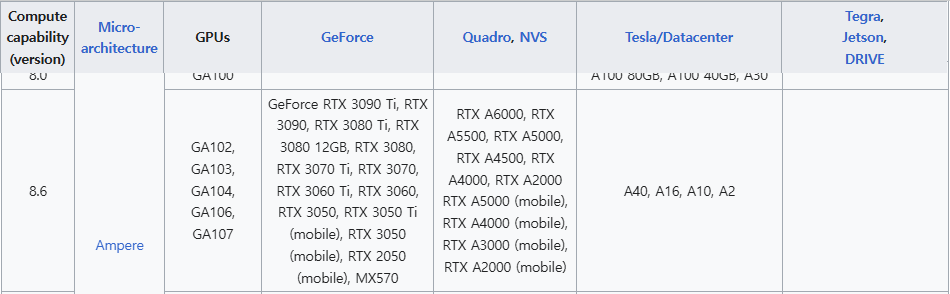

우선 Compute capability, GPU semiconductors and Nvidia GPU board products 표를 보고 GeForce 열에서 자신의 GPU 이름을 찾는다. 이후 같은 행의 Compute capability(version)을 확인한다. 필자 기준 8.6인걸 확인할 수 있다.

이후 Compute capability (CUDA SDK support vs. microarchitecture)표에서 Compute capability(version) 즉, 8.6이 포함되는 CUDA SDK version(s)를 확인한다. 필자의 경우 11.1~12.8까지 호환되는 것을 확인할 수 있다. 이 버전이 내 GPU와 호환되는 CUDA 버전이다.

2. NVIDIA 드라이버 설치

CUDA를 설치하기 전에 NVIDIA 드라이버를 설치해줘야한다. 아래 사이트에 들어가서 수동 드라이버 검색 탭을 사용하여 본인의 GPU 정보를 입력하고 드라이버를 설치한다.

https://www.nvidia.com/ko-kr/drivers/

최신 정식 NVIDIA 드라이버 다운로드

최신 정식 NVIDIA 드라이버를 다운로드하여 PC 게임 경험을 향상시키고 앱을 더 빠르게 실행하세요.

www.nvidia.com

3. CUDA와 cuDNN의 Tensorflow-gpu, PyTorch 호환 버전 확인

우선 CUDA와 cuDNN을 설치하기 전에 Tensorflow-gpu 또는 PyTorch와 호환되는 버전을 확인해야한다.

1) Tensorflow-gpu

텐서플로우의 경우 아래 사이트에서 호환되는 CUDA와 cuDNN에 대한 정보를 확인할 수 있다.

https://www.tensorflow.org/install/source_windows?hl=ko#gpu

Windows의 소스에서 빌드,Windows의 소스에서 빌드 | TensorFlow

이 페이지는 Cloud Translation API를 통해 번역되었습니다. Windows의 소스에서 빌드,Windows의 소스에서 빌드 컬렉션을 사용해 정리하기 내 환경설정을 기준으로 콘텐츠를 저장하고 분류하세요. 소스에

www.tensorflow.org

위의 사이트에 들어가서 내가 설치할 tensorflow-gpu 버전을 찾고 거기에 호환되는 CUDA, cuDNN 버전 정보를 확인한다.

필자의 경우 tensorflow-gpu-2.10.0을 설치하려고 하는데, 우측에 보면 확인할 수 있듯이 이는 cuDNN은 8.1, CUDA는 11.2를 요구한다. 이때, 내 GPU가 호환되는 CUDA 버전에 11.2이가 포함되는지를 확인해야한다. 우리는 맨처음 자신의 GPU와 호환되는 CUDA의 버전 범위를 확인했었다. 그 범위와 비교하여 범위 내에 포함되는지를 확인해야한다. 필자의 경우 11.1~12.8 범위가 호환됐었고 설치하려는 tensorflow-gpu-2.10.0이 필요한 CUDA 버전이 이에 포함 됨으로 설치가 가능하다.

만약 내 호환 범위에 포함되지 않는다면 포함되는 tensorflow-gpu의 다른 버전을 설치하면된다.

그리고 파이썬 버전도 확인할 수 있는데 이는 3.7~3.10까지 호환된다는 것이고, 후에 아나콘다 가상환경 설정을 위해 기억해놓아야한다.

2) PyTorch

https://pytorch.org/get-started/previous-versions/

Previous PyTorch Versions

Installing previous versions of PyTorch

pytorch.org

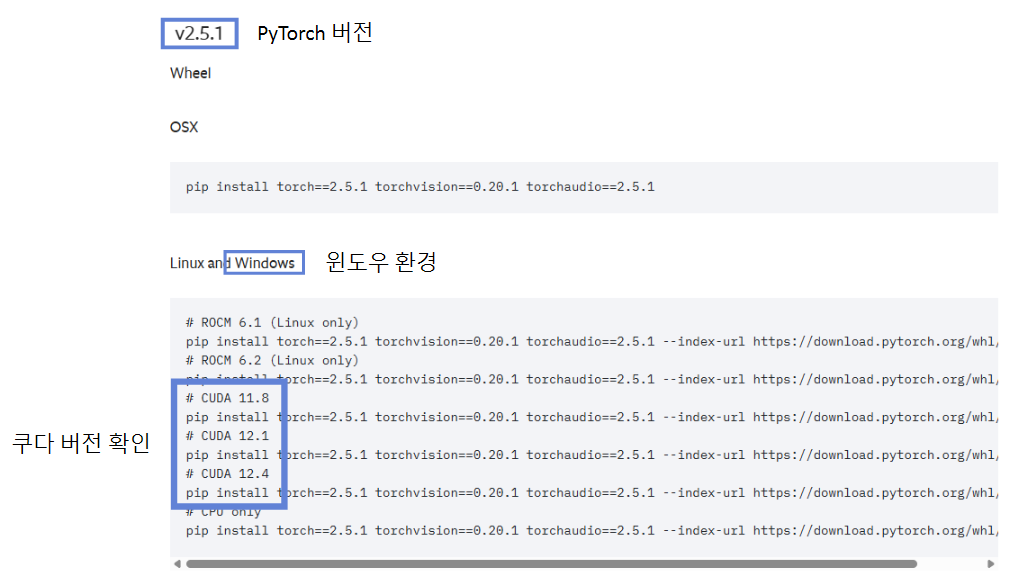

파이토치의 경우는 위의 사이트에 들어가서 아래와 같이 본인이 다운 받고 싶은 PyTorch 버전을 찾고, 본 포스팅은 윈도우 환경 기준이므로 windows로 가서 호환되는 CUDA 버전을 확인한다. 아래 그림을 해석하면 PyTorch 2.5.1 버전에서는 CUDA 11.8, 12.1, 12.4를 지원한다는 의미이다.

따라서 위 11.8, 12.1, 12.4가 내 GPU와 호환되는 범위인지 확인하고 선택해서 CUDA를 설치하면된다.

4. 요구 조건과 내 사양 정리

PyTorch도 과정이 같기 때문에 tensorflow-gpu 경우를 계속 예시를 들어 진행하겠다.

우선 설치하기에 앞서 헷갈리지 않기 위해 다시 한 번 내용을 정리하고 가도록 하겠다.

1) 내 사양

- GPU 사양 : GeForece RTX 3060 Ti

- 지원되는 CUDA 버전 범위 : 11.1~12.8

- OS 환경 : Windows 64bit

2) tensorflow-gpu-2.10.0 요구 사항

- Python : 3.7~3.10

- CUDA : 11.2

- cuDNN : 8.1

내 사양에서 지원되는 CUDA 버전 범위 안에 tensorflow-gpu-2.10.0의 요구사항인 CUDA 버전이 포함됨으로, 이제 해당 버전의 CUDA를 설치하면 된다.

5. CUDA (CUDA Toolkit) 설치

CUDA 설치는 아래 사이트에 들어가서 내가 설치하려는 버전을 찾아 설치하면 된다.

https://developer.nvidia.com/cuda-toolkit-archive

CUDA Toolkit Archive

Previous releases of the CUDA Toolkit, GPU Computing SDK, documentation and developer drivers can be found using the links below. Please select the release you want from the list below, and be sure to check www.nvidia.com/drivers for more recent production

developer.nvidia.com

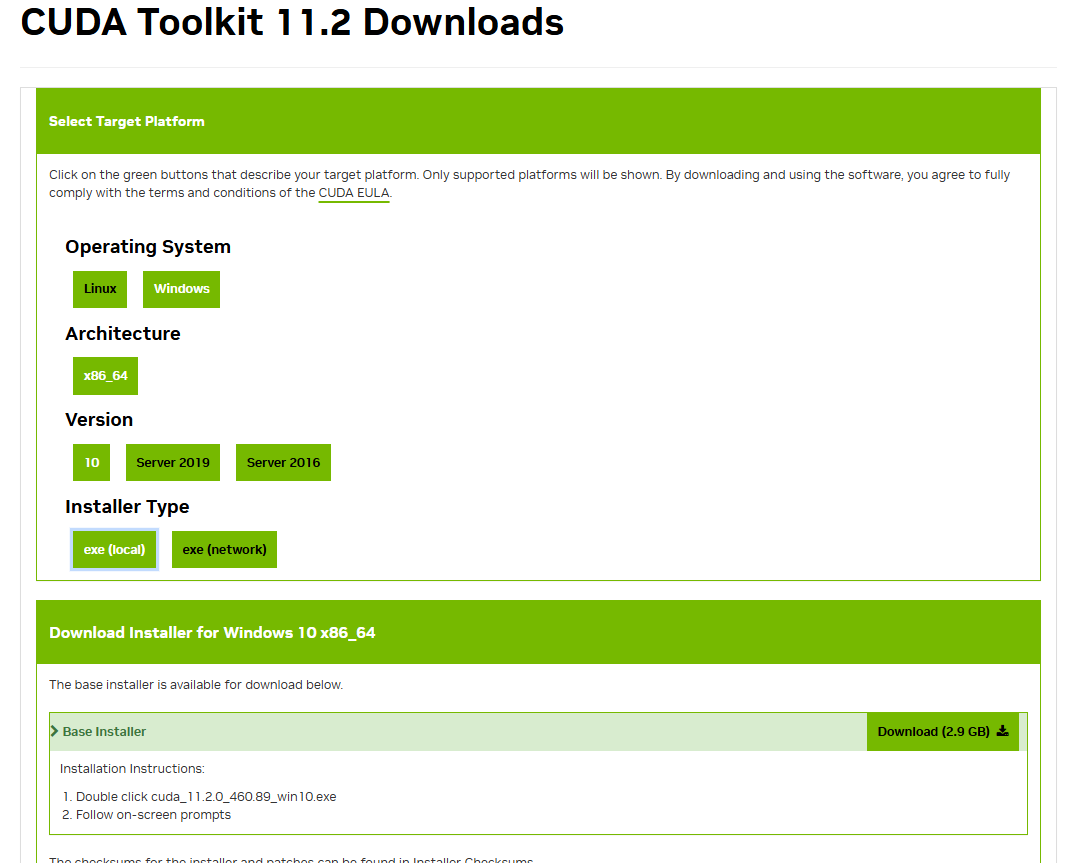

필자는 11.2를 설치하려고 하므로 CUDA Toolkit 11.2.X를 설치했다.

CUDA Toolkit 11.2.X를 클릭한 후, 아래와 같이 설정하고 다운로드 하면 된다.

설치를 완료하면 아래 기본 경로에 CUDA가 설치되게 된다.

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v버전

6. cuDNN 설치

이제 CUDA를 설치햇으니 cuDNN을 설치할 차례이다.

cuDNN은 아래 사이트에서 설치를 하면 된다. 이때 로그인을 하고 설치를 해야하므로 회원가입을 한 후 설치를 하면된다.

https://developer.nvidia.com/rdp/cudnn-archive

cuDNN Archive

Download releases from the GPU-accelerated primitive library for deep neural networks.

developer.nvidia.com

우리가 설치해야하는 버전은 cuDNN 8.1이므로 8.1을 찾고 이 중 본인이 설치한 CUDA 버전을 지원하는 cuDNN을 설치하면된다. 필자의 경우 CUDA 11.2를 지원하는 위에서부터 첫 번째와 세 번째를 설치하면 되는 것이다.

cuDNN은 다운로드에 설치가 되고 cuDNN 압축을 풀고 파일(bin, include, lib)을 CUDA가 설치되어 있는 경로( C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v버전)로 가서 CUDA 폴더 속 bin, include, lib에 덮어씌우면 된다.

이렇게 하면, NVIDIA 드라이버 설치, CUDA 설치, cuDNN 설치를 끝이 난다.

아나콘다에서 가상환경을 설정하고, tensorflow-gpu나 PyTorch를 설치하는 방법은 아래 포스팅에서 설명되어있다.

https://pgeun02.tistory.com/14

아나콘다 가상환경 생성 및 TensorFlow, PyTorch 환경 구현

해당 포스팅은 앞의 포스팅의 뒷 이야기로 읽고 오시면 도움이됩니다.https://pgeun02.tistory.com/13 Window(윈도우) 환경에서 GPU 활용을 위한 CUDA, cuDNN 설치이 글은 tensorflow-gpu, PyTorch를 사용하기 위해 CUD

pgeun02.tistory.com

'자연어 처리(NLP)' 카테고리의 다른 글

| 아나콘다 가상환경 생성 및 TensorFlow, PyTorch 환경 구현 (0) | 2025.04.04 |

|---|